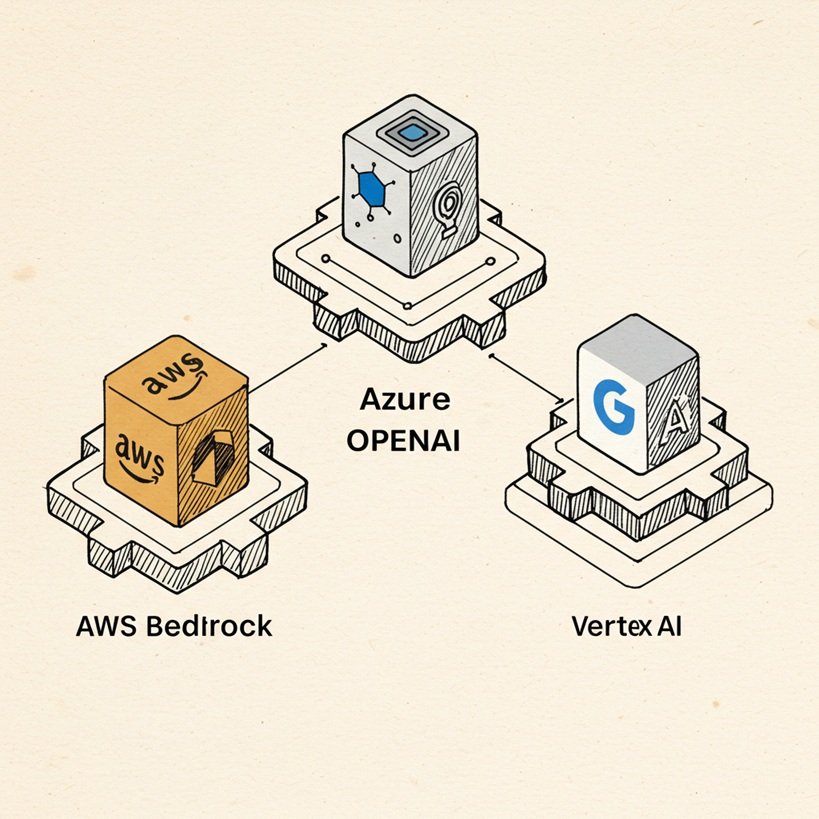

AWS Bedrock vs Azure OpenAI vs Vertex AI: 기업용 AI 비교

AWS Bedrock, Azure OpenAI, Google Vertex AI 중 최적의 엔터프라이즈 AI 서비스는? 모델 선택, 맞춤화, 보안, 가격까지 완벽 비교 분석으로 적절한 선택을 도와드릴 수 있도록 작성해보았습니다.

기업 환경에서 인공지능(AI), 특히 생성형 AI와 파운데이션 모델(Foundation Models, FM)의 도입은 더 이상 선택이 아닌 필수가 되었습니다. 하지만 어떤 플랫폼을 선택해야 할지 막막하기만 합니다. 클라우드 거인들이 앞다투어 선보이는 AWS Bedrock vs Azure OpenAI Service vs Google Vertex AI는 각기 다른 강점과 특징을 내세우며 기업들의 선택을 기다리고 있습니다. 단순히 특정 모델을 사용하는 것을 넘어, 기존 인프라와의 통합, 데이터 보안, 비용 효율성, 맞춤화 가능성 등 고려해야 할 요소가 너무나 많습니다.

이 글에서는 엔터프라이즈 AI 서비스의 대표 주자인 AWS Bedrock, Azure OpenAI Service, Google Vertex AI 세 가지 플랫폼을 심층적으로 비교 분석합니다. 각 플랫폼의 핵심 철학과 제공 기능, 주요 모델 라인업, 맞춤화 옵션, 보안 및 거버넌스 특징, 그리고 가격 정책까지 기업의 의사결정권자와 개발자 관점에서 실질적으로 궁금해할 만한 내용들을 살펴보겠습니다.

엔터프라이즈 AI 플랫폼 3대장: 무엇이 다를까?

세 플랫폼 모두 기업이 파운데이션 모델을 활용하여 AI 애플리케이션을 구축하고 배포할 수 있도록 지원하는 서비스형 플랫폼(PaaS)입니다. 하지만 그 접근 방식과 핵심 철학에는 차이가 있습니다.

- AWS Bedrock: ‘선택의 자유’와 ‘AWS 생태계 통합’을 강조합니다. Amazon 자체 모델(Titan)뿐만 아니라 Anthropic(Claude), AI21 Labs(Jurassic), Cohere, Meta(Llama) 등 다양한 선도 AI 기업의 고성능 파운데이션 모델을 API 형태로 쉽게 접근하고 활용할 수 있도록 지원합니다. 서버리스 아키텍처를 기반으로 하며, 기존 AWS 서비스(S3, SageMaker 등)와의 긴밀한 연동을 통해 데이터 준비부터 모델 배포까지 원활하게 연결하는 데 중점을 둡니다.

- Azure OpenAI Service: ‘최첨단 OpenAI 모델’과 ‘Microsoft 생태계 시너지’를 핵심 가치로 내세웁니다. OpenAI의 최신 GPT 모델(GPT-4, GPT-4 Turbo 등), DALL-E, Whisper 등을 Azure의 엔터프라이즈급 보안, 규정 준수, 가용성 위에서 안정적으로 사용할 수 있도록 제공합니다. 특히 Microsoft 365 Copilot의 기반 기술이기도 하며, Azure의 다양한 서비스(Azure AI Search, Azure ML 등) 및 Microsoft의 업무 생산성 도구와의 강력한 통합이 특징입니다.

- Google Vertex AI: ‘엔드투엔드 MLOps 플랫폼’과 ‘Google AI 및 오픈소스 모델 접근성’을 강점으로 합니다. Google 자체 개발 모델(Gemini, PaLM, Imagen 등)과 더불어 Model Garden을 통해 다양한 오픈소스 및 서드파티 모델을 탐색하고 활용할 수 있습니다. 데이터 관리, 모델 학습/튜닝, 배포, 모니터링 등 머신러닝 워크플로우 전체를 통합적으로 관리하는 데 강점을 가지며, BigQuery, Looker 등 Google Cloud의 데이터 분석 도구와의 연동성이 뛰어납니다.

핵심 기능 비교: 모델, 맞춤화, 통합, 그리고 엔터프라이즈 준비성

기업이 AI 플랫폼을 선택할 때 가장 중요하게 고려하는 핵심 기능들을 중심으로 세 플랫폼을 비교해 보겠습니다.

1. 사용 가능한 파운데이션 모델: 선택의 폭은 어디가 넓을까?

- AWS Bedrock: 모델 선택의 폭이 가장 넓습니다. Amazon Titan, Anthropic Claude 3 (Haiku, Sonnet, Opus), Cohere Command, AI21 Labs Jurassic, Meta Llama 3 등 다양한 고성능 모델을 제공하여, 특정 작업에 가장 적합하거나 비용 효율적인 모델을 유연하게 선택하고 실험해볼 수 있습니다. 특정 모델 벤더에 종속되지 않는다는 장점이 있습니다.

- Azure OpenAI Service: OpenAI의 최신 및 최고 성능 모델(GPT-4, GPT-4o, DALL-E 3 등)에 대한 접근성이 가장 뛰어납니다. OpenAI와의 긴밀한 파트너십을 통해 최신 모델을 빠르게 도입하고 Azure 환경에서 안정적으로 제공하는 데 집중합니다. 모델 선택의 폭은 Bedrock보다 좁지만, OpenAI 모델의 강력한 성능을 선호하는 기업에게 매력적입니다.

- Google Vertex AI: Google의 자체 개발 모델(Gemini, PaLM 2, Imagen 등)과 함께 Model Garden을 통해 Meta Llama, TII Falcon 등 다양한 오픈소스 모델 및 서드파티 모델에 대한 접근을 제공합니다. 특히 Gemini 모델은 멀티모달 기능에서 강점을 보이며, 오픈소스 모델 활용을 선호하는 기업에게 유리한 환경을 제공합니다.

2. 모델 맞춤화(Customization): 우리 회사 데이터로 더 똑똑하게 만들 수 있을까?

기업의 특정 도메인 지식이나 고유 데이터를 반영하여 파운데이션 모델의 성능을 향상시키는 것은 매우 중요합니다. 세 플랫폼 모두 모델 맞춤화 기능을 지원하지만, 방식과 깊이에는 차이가 있습니다.

- AWS Bedrock: 파인튜닝(Fine-tuning)과 검색 증강 생성(Retrieval Augmented Generation, RAG) 방식을 모두 지원합니다. 특정 모델(예: Titan, Llama, Cohere)에 대해 자체 데이터를 사용하여 파인튜닝을 수행할 수 있으며, Amazon Kendra나 OpenSearch 등과 연계하여 RAG 기반의 지식 검색 및 답변 생성 시스템 구축을 용이하게 지원합니다. ‘Continued Pre-training’과 같은 고급 기법도 일부 모델에 제공합니다.

- Azure OpenAI Service: GPT-3.5 Turbo 모델 등에 대한 파인튜닝 기능을 제공합니다. 또한 Azure AI Search(구 Cognitive Search) 와의 강력한 통합을 통해 RAG 시스템 구축을 적극 지원하며, 관련 레퍼런스 아키텍처와 가이드가 풍부합니다. 기업 데이터를 활용하여 정확하고 신뢰성 있는 답변을 생성하는 데 중점을 둡니다.

- Google Vertex AI: 다양한 튜닝 방법을 제공하는 것이 특징입니다. 지도 학습 기반 파인튜닝(Supervised fine-tuning), 프롬프트 튜닝(Prompt tuning), 인간 피드백 기반 강화 학습(RLHF) 등 모델과 작업 유형에 맞는 여러 옵션을 제공합니다. Vertex AI Search(구 Enterprise Search) 및 Vector Search를 활용한 RAG 구현 역시 강력하게 지원하며, 엔드투엔드 MLOps 플랫폼의 강점을 살려 데이터 준비부터 튜닝, 평가까지 통합 관리가 용이합니다.

3. 기존 시스템과의 통합: 우리 회사 인프라와 잘 맞을까?

AI 플랫폼은 독립적으로 존재하기보다 기존 시스템과 유기적으로 연동될 때 그 가치가 극대화됩니다. 각 플랫폼은 자사의 클라우드 생태계와의 통합에 강점을 보입니다.

- AWS Bedrock: AWS 서비스와의 긴밀한 통합이 핵심 강점입니다. Amazon S3(데이터 저장), SageMaker(ML 플랫폼), Lambda(서버리스 컴퓨팅), Kendra(지능형 검색) 등 다양한 AWS 서비스와 쉽게 연동하여 데이터 처리, 모델 활용, 애플리케이션 구축 파이프라인을 효율적으로 구성할 수 있습니다. 기존 AWS 인프라를 활용하는 기업에게 매우 유리합니다.

- Azure OpenAI Service: Microsoft 생태계와의 완벽한 통합을 자랑합니다. 특히 Microsoft 365 Copilot과의 연계를 통해 Word, Excel, Teams 등 업무 생산성 도구에서 AI 기능을 직접 활용할 수 있다는 점이 강력합니다. 또한 Azure AI Studio, Azure Machine Learning, Power Platform 등 다른 Azure 서비스와의 통합도 원활합니다.

- Google Vertex AI: Google Cloud Platform(GCP) 서비스와의 강력한 연동성을 제공합니다. BigQuery(데이터 웨어하우스), Looker(BI), Google Cloud Storage 등 GCP의 데이터 및 분석 도구와 매끄럽게 통합되어 데이터 기반의 AI 모델 개발 및 활용에 시너지를 낼 수 있습니다. 엔드투엔드 MLOps 관점에서 Vertex AI 파이프라인과의 통합이 강점입니다.

4. 엔터프라이즈 준비성: 보안, 개인정보보호, 규정 준수는?

기업 환경에서는 모델 성능만큼이나 보안, 개인정보보호, 규정 준수, 책임감 있는 AI(Responsible AI)가 중요합니다. 세 플랫폼 모두 이 부분을 강조하며 다양한 기능을 제공합니다.

- AWS Bedrock: VPC 엔드포인트, PrivateLink를 통한 비공개 네트워크 연결, AWS IAM을 통한 접근 제어, CloudTrail을 통한 감사 로깅 등 AWS의 강력한 보안 기능을 활용합니다. 고객 데이터는 모델 학습에 사용되지 않으며, 데이터 암호화 옵션을 제공합니다. HIPAA 등 주요 규정 준수를 지원합니다.

- Azure OpenAI Service: Azure의 엔터프라이즈급 보안 및 규정 준수 표준을 따릅니다. 가상 네트워크(VNet) 지원, Private Endpoint, Azure Active Directory(현 Microsoft Entra ID) 기반 인증 등 강력한 보안 기능을 제공합니다. 고객 데이터는 모델 학습에 사용되지 않음을 명시하며, HIPAA, GDPR 등 다양한 산업 표준을 준수합니다. Azure AI Content Safety와 같은 책임감 있는 AI 도구를 통합 제공합니다.

- Google Vertex AI: Google Cloud의 보안 및 규정 준수 프레임워크를 기반으로 합니다. VPC Service Controls, IAM, 데이터 암호화 등 강력한 보안 기능을 제공하며, 고객 데이터는 모델 학습에 사용되지 않습니다. HIPAA, GDPR 등 주요 규정을 준수합니다. Explainable AI, Model Monitoring 등 MLOps 관점의 책임감 있는 AI 도구와 거버넌스 기능이 강점입니다.

AWS Bedrock vs Azure OpenAI vs Vertex AI: 핵심 차이점 비교

| 비교 항목 | AWS Bedrock | Azure OpenAI Service | Google Vertex AI |

| 핵심 철학 | 모델 선택의 자유, AWS 생태계 통합 | 최신 OpenAI 모델 접근성, Microsoft 생태계 시너지 | 엔드투엔드 MLOps, Google AI + 오픈소스 모델 활용 |

| 모델 다양성 | 매우 높음 (Amazon, Anthropic, Cohere, Meta 등) | 중간 (OpenAI 모델 중심) | 높음 (Google 자체 모델 + Model Garden 오픈소스) |

| 최신/최고 모델 접근성 | 주요 모델 빠르게 도입 | 매우 뛰어남 (OpenAI 최신 모델) | Google 최신 모델(Gemini 등) 및 다양한 OSS 모델 |

| 모델 맞춤화 | 파인튜닝(일부 모델), RAG (Kendra 연동 등) | 파인튜닝(일부 모델), RAG (Azure AI Search 연동) | 다양한 튜닝 옵션, RAG (Vertex AI Search 연동) |

| M365 통합 | 제한적 | 매우 강력 (Copilot 기반) | 제한적 |

| 클라우드 통합 | AWS 서비스와 긴밀 | Azure 서비스 및 Microsoft 제품과 긴밀 | GCP 서비스(특히 데이터/MLOps)와 긴밀 |

| MLOps 통합 수준 | SageMaker 연동 가능 | Azure ML 연동 가능 | 플랫폼 자체에 강력한 MLOps 기능 내장 |

| 보안/ 규정 준수 | AWS 표준 (VPC, IAM 등) | Azure 표준 (VNet, Entra ID, Content Safety 등) | GCP 표준 (VPC-SC, IAM, Explainable AI 등) |

| 가격 모델 | 모델별 종량제, 프로비저닝된 처리량 | 모델별 종량제, 프로비저닝된 처리량 | 모델별 종량제, 머신 타입/사용 시간 기반 (튜닝/배포) |

| 주요 강점 요약 | 유연한 모델 선택, AWS 인프라 활용 극대화 | OpenAI 최신 기술 활용, M365 업무 효율 혁신 | 강력한 MLOps, Google AI/OSS 활용, 데이터 기반 AI 개발 |

분석:

- AWS Bedrock은 이미 AWS를 광범위하게 사용하고 있으며, 특정 모델에 종속되지 않고 다양한 옵션을 비교하며 사용하고 싶은 기업에게 매력적입니다.

- Azure OpenAI Service는 Microsoft 365를 핵심 업무 도구로 사용하며, OpenAI의 최첨단 모델을 활용하여 업무 생산성을 혁신하고자 하는 기업에게 가장 적합한 선택일 수 있습니다.

- Google Vertex AI는 자체적으로 ML 모델을 개발하고 운영하는 역량을 갖추고 있거나, 데이터 분석부터 모델 배포, 모니터링까지 전체 MLOps 파이프라인을 통합 관리하고자 하는 기업, 또는 Google의 AI 기술 및 오픈소스 모델 활용에 관심 있는 기업에게 강력한 플랫폼을 제공합니다.

어떤 기업에 어떤 플랫폼이 최적일까?: 사용 사례 기반 선택 가이드

- 시나리오 1: 다양한 산업군의 LLM 기반 챗봇/어시스턴트 구축 (모델 유연성 중요)

- 다양한 고객 응대 시나리오나 내부 직원 지원 용도로 챗봇을 구축하려 하며, 특정 모델이 아닌 여러 모델을 테스트하고 최적의 성능/비용 조합을 찾고 싶다면 AWS Bedrock이 유리할 수 있습니다. Claude의 긴 컨텍스트 처리 능력이나 Llama의 오픈 소스 기반 접근성 등 다양한 모델의 장점을 활용할 수 있습니다.

- 시나리오 2: Microsoft Teams 회의 요약 및 후속 조치 자동화 (M365 통합 필수)

- Teams 회의 내용을 자동으로 요약하고, 논의된 내용을 바탕으로 Outlook에서 후속 메일 초안을 작성하는 등 Microsoft 365 앱 내에서의 자동화 및 생산성 향상이 목표라면 Azure OpenAI Service (Copilot for Microsoft 365) 가 거의 유일한 현실적인 선택지입니다.

- 시나리오 3: 자체 보유 대규모 데이터셋 기반의 고도로 맞춤화된 모델 개발 및 운영 (MLOps 역량 중요)

- 금융 사기 탐지, 의료 영상 분석 등 특정 도메인의 대규모 데이터를 활용하여 파운데이션 모델을 정교하게 튜닝하고, 지속적으로 모델 성능을 모니터링하며 재학습하는 등 전체 MLOps 라이프사이클 관리가 필요하다면 Google Vertex AI의 통합된 환경과 다양한 튜닝 옵션이 강점을 발휘할 수 있습니다.

- 시나리오 4: 최신 GPT-4o 모델을 활용한 창의적인 콘텐츠 생성 애플리케이션 개발

- 최신 멀티모달 기능 등을 포함한 GPT-4o 모델의 성능을 최대한 활용하여 새로운 서비스나 애플리케이션을 개발하고자 한다면, Azure OpenAI Service를 통해 안정적으로 해당 모델에 접근하는 것이 좋은 전략일 수 있습니다.

가격 비교: 비용 효율적인 선택은 무엇일까?

세 플랫폼 모두 기본적으로 사용량 기반(주로 입력/출력 토큰 수 기준)의 종량제 모델을 채택하고 있지만, 세부적인 가격 책정 방식과 추가 옵션에는 차이가 있습니다.

- AWS Bedrock: 모델 제공자별, 모델별로 가격이 상이합니다. 온디맨드(토큰당 과금) 방식 외에, 특정 처리량을 보장받고 비용을 절감할 수 있는 ‘프로비저닝된 처리량(Provisioned Throughput)’ 옵션을 제공합니다.

- Azure OpenAI Service: 모델별(GPT-4, GPT-3.5 등) 및 기능별(파인튜닝, 이미지 생성 등)로 토큰당 가격이 책정됩니다. 일부 모델에 대해 ‘프로비저닝된 처리량 단위(PTU)’ 구매 옵션을 제공하여 대규모 워크로드의 비용 예측 가능성을 높입니다.

- Google Vertex AI: 모델별 토큰 기반 과금 외에도, 모델 튜닝이나 배포 시 사용하는 컴퓨팅 자원(머신 타입, 사용 시간)에 대한 비용이 별도로 발생할 수 있습니다. 엔드투엔드 플랫폼 특성상 다양한 구성 요소에 대한 비용 고려가 필요합니다.

주의: 가격은 모델, 리전, 사용량, 약정 여부 등에 따라 매우 복잡하게 달라지므로, 반드시 각 플랫폼의 공식 가격 페이지 및 계산기를 통해 예상 비용을 면밀히 검토해야 합니다. 특정 모델의 토큰당 단가만 비교하기보다, 전체 워크플로우(데이터 처리, 튜닝, 추론, 모니터링 등)를 고려한 총 소유 비용(TCO) 관점에서 접근하는 것이 중요합니다.

우리 회사에 맞는 엔터프라이즈 AI 플랫폼 찾기

AWS Bedrock, Azure OpenAI Service, Google Vertex AI는 각각 강력한 기능과 장점을 가진 훌륭한 엔터프라이즈 AI 플랫폼입니다. 어떤 플랫폼이 ‘절대적으로 최고’라고 말하기는 어렵습니다. 최적의 선택은 각 기업의 구체적인 비즈니스 요구사항, 기술적 성숙도, 기존 클라우드 인프라, 예산, 그리고 AI 활용 전략에 따라 달라질 것입니다.

- 다양한 모델 선택권과 기존 AWS 인프라와의 긴밀한 통합을 최우선으로 생각한다면 AWS Bedrock을 고려해볼 수 있습니다.

- OpenAI의 최첨단 모델 활용과 Microsoft 365 환경에서의 업무 생산성 혁신이 목표라면 Azure OpenAI Service가 강력한 후보입니다.

- 엔드투엔드 MLOps 역량 강화, Google AI 기술 및 오픈소스 모델 활용, 데이터 기반 AI 개발에 중점을 둔다면 Google Vertex AI가 적합할 수 있습니다.

성공적인 AI 도입을 위해서는 단순히 플랫폼을 선택하는 것을 넘어, 명확한 목표 설정, 데이터 준비, 적절한 사용 사례 발굴, 책임감 있는 AI 원칙 적용, 그리고 지속적인 학습과 개선 노력이 함께 이루어져야 합니다. 각 플랫폼의 무료 티어(사용 가능한 경우)나 PoC(Proof of Concept)를 통해 직접 테스트해보고, 우리 조직의 상황에 가장 잘 맞는 파트너를 신중하게 선택하시기를 바랍니다.

네, 예를 들어 Llama 3와 같은 인기 있는 오픈소스 모델은 세 플랫폼 모두에서 제공될 수 있습니다. 하지만 각 플랫폼이 모델을 호스팅하고 서빙하는 방식, 기본 설정, 하드웨어 인프라 등에 미묘한 차이가 있을 수 있어 동일 모델이라도 약간의 성능 차이나 응답 속도 차이가 발생할 수 있습니다. 또한, 각 플랫폼에서 제공하는 모델 튜닝 기능이나 통합 서비스와의 연계 방식이 다르므로, 실제 사용 시 경험은 플랫폼별로 다를 수 있습니다. 따라서 특정 오픈소스 모델 사용이 중요하다면, 각 플랫폼에서 해당 모델을 직접 테스트해보는 것이 좋습니다.

파인튜닝은 모델 자체를 특정 작업이나 도메인 지식에 맞게 재학습시키는 방식으로, 모델이 특정 스타일의 텍스트를 생성하거나 특정 용어를 더 잘 이해하도록 만드는 데 효과적입니다. 하지만 상당한 양의 고품질 학습 데이터와 컴퓨팅 자원이 필요하며 비용이 더 많이 들 수 있습니다. RAG는 외부 지식 베이스(예: 회사 내부 문서, 최신 정보 데이터베이스)를 검색하여 관련 정보를 찾아 프롬프트에 함께 제공함으로써, 모델이 최신 정보나 특정 지식에 기반하여 답변하도록 유도하는 방식입니다. 비교적 적은 비용으로 모델의 지식 부족 문제를 해결하고 환각 현상을 줄이는 데 효과적입니다. 일반적으로는 RAG 방식이 구현 및 유지 관리가 더 용이하여 많은 기업에서 우선적으로 고려하며, 필요에 따라 파인튜닝을 병행하거나 보완적으로 사용합니다. 해결하려는 문제의 성격, 보유 데이터의 양과 질, 예산 등을 종합적으로 고려하여 선택해야 합니다.

세 플랫폼 모두 엔터프라이즈 고객의 데이터 보안 및 개인정보보호를 최우선으로 고려합니다. 일반적으로 기업용 플랜(예: AWS Bedrock의 비공개 호스팅 옵션, Azure OpenAI Service, Vertex AI)에서는 고객이 제공한 데이터를 해당 고객의 모델 맞춤화 외 다른 목적으로 사용하거나 외부 모델 학습에 활용하지 않음을 명시합니다. 데이터는 전송 및 저장 시 암호화되며, VPC 엔드포인트나 Private Link/Private Endpoint 등을 통해 인터넷을 거치지 않는 비공개 네트워크 연결을 지원하여 보안을 강화합니다. 하지만 정확한 정책은 각 플랫폼 및 계약 조건에 따라 다를 수 있으므로, 반드시 서비스 약관 및 개인정보 처리 방침을 면밀히 확인하고 필요시 클라우드 제공사와 직접 상담하는 것이 중요합니다.

네, 각 플랫폼은 제한적이나마 무료로 시작하거나 테스트해볼 수 있는 방법을 제공하는 경우가 많습니다.

AWS: AWS Free Tier를 통해 특정 기간 동안 제한된 사용량의 Bedrock 모델(예: 일부 Titan 모델) 또는 관련 서비스(예: Lambda, S3)를 무료로 사용할 수 있습니다.

Azure: Azure Free Account를 통해 일정 금액의 크레딧을 제공받아 Azure OpenAI Service를 포함한 다양한 서비스를 테스트해볼 수 있습니다. 또한 웹 기반의 Copilot은 무료로 사용 가능합니다.

Google Cloud: Google Cloud Free Tier를 통해 Vertex AI의 특정 기능(예: 일부 모델 API 호출)을 제한된 사용량까지 무료로 제공하거나, 신규 고객에게 상당한 금액의 무료 크레딧을 제공하여 플랫폼을 탐색할 수 있도록 지원합니다.

단, 무료 티어의 조건과 제공 범위는 수시로 변경될 수 있으므로 각 플랫폼의 공식 웹사이트에서 최신 정보를 확인하는 것이 필수적입니다.

반드시 그렇지는 않습니다. 물론 기존 클라우드 인프라와의 통합 용이성, 익숙한 관리 환경, 기존 계약 관계 등을 고려할 때 자사 클라우드 플랫폼을 선택하는 것이 자연스럽고 유리한 경우가 많습니다. AWS 사용 기업이 Bedrock을 선택하면 데이터 이동이나 서비스 연동이 훨씬 수월할 것입니다. 하지만 AI 모델의 성능, 특정 기능(예: M365 통합), 비용 효율성, 개발팀의 기술 스택 등 다른 요소들이 더 중요하다면 멀티 클라우드 전략의 일환으로 다른 플랫폼을 고려할 수도 있습니다. 예를 들어, AWS를 주로 사용하더라도 Teams 회의 요약 자동화가 핵심 요구사항이라면 Azure OpenAI Service(Copilot for M365) 도입을 검토해볼 가치가 있습니다. 각 플랫폼의 장단점을 객관적으로 평가하고, 우리 조직의 최우선 순위에 맞춰 전략적인 결정을 내리는 것이 중요합니다.