GPT-4, Mixtral, DeepSeek의 핵심 기술인 MoE의 작동 원리와 전략적 가치를 심층 분석합니다. 전문가 붕괴, VRAM 병목 등 실무적 난제와 해결책을 포함한 기술 리포트입니다.

추론 비용 폭탄, 언제까지 감당하실 겁니까?

“성능 좋은 70B 모델을 쓰고 싶은데, 추론 속도가 너무 느리고 GPU 비용이 감당이 안 됩니다.” AI 서비스를 운영하는 CTO나 엔지니어들이 사석에서 가장 많이 토로하는 고민입니다. 모델의 크기(Size)가 커질수록 똑똑해지는 건 알겠는데, 그에 비례해 기하급수적으로 늘어나는 연산 비용은 비즈니스의 지속 가능성을 위협합니다.

여기서 MoE(Mixture of Experts, 전문가 혼합) 모델이 게임 체인저로 등장합니다. GPT-4가 사실은 거대한 단일 모델이 아니라는 소문, Mixtral 8x7B가 보여준 놀라운 가성비, 그리고 최근 DeepSeek-V3가 보여준 압도적인 효율성까지. 이 모든 혁신의 중심에는 MoE가 있습니다.

하지만 단순히 “MoE는 빠르고 좋다”라고만 알고 있다면 반쪽짜리 지식입니다. MoE는 ‘공짜 점심’이 아닙니다. 잘못 도입하면 전문가 붕괴(Expert Collapse)라는 치명적인 오류에 빠지거나, 연산량은 줄었지만 VRAM은 폭발하는 기형적인 구조에 갇힐 수 있습니다. 오늘은 MoE가 어떻게 거대 모델의 패러다임을 바꾸고 있는지, 그리고 현장에서 마주할 진짜 기술적 난제는 무엇인지 해부해보겠습니다.

MoE 도입 전 반드시 체크할 3가지 핵심 요약

- 연산의 효율화: 모든 파라미터를 쓰지 않고, 질문에 필요한 상위 K개의 전문가(Top-K Experts)만 골라 씀으로써 100B급 모델을 10B급 비용으로 돌립니다.

- 메모리의 역설: 연산 속도(Latency)는 빠르지만, 모든 전문가를 대기시켜야 하므로 VRAM 요구량은 여전히 거대합니다. (VRAM 부자들의 기술)

- 훈련의 난이도: 특정 전문가만 편애하는 쏠림 현상을 막기 위해 정교한 로드 밸런싱(Load Balancing) 전략이 필수입니다.

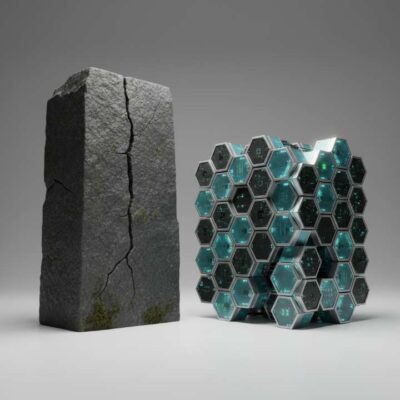

‘조건부 연산’의 미학: 뇌를 닮아가는 아키텍처

전통적인 Dense(밀집) 모델은 ‘오늘 날씨 어때?’라는 간단한 질문에도 모델 내의 1,000억 개 뉴런을 모두 깨워 연산합니다. 비효율의 극치입니다. 반면 MoE는 Sparse(희소) 모델을 지향합니다. 필요한 부분만 활성화한다는 뜻입니다.

게이팅 네트워크(Gating Network): 트래픽을 지휘하는 관제탑

MoE의 핵심은 라우터(Router)라고도 불리는 게이팅 네트워크입니다. 입력된 토큰(Token)을 분석하여 “이건 코딩 문제니까 코딩 전문가에게 보내”, “이건 문학적 표현이니 소설가 전문가에게 보내”라고 동적 라우팅(Dynamic Routing)을 수행합니다.

- Dense 모델: 모든 의사가 달라붙어 감기 환자 한 명을 진료함.

- MoE 모델: 접수처(Router)에서 환자를 분류하여 호흡기 내과 전문의(Expert)에게만 보냄.

최근 공개된 DeepSeek-V3의 경우, 총 671B(6,710억) 파라미터를 가지고 있지만, 토큰당 활성화되는 파라미터는 37B(370억) 개에 불과합니다. 즉, GPT-4급의 지식을 가지고 있지만, Llama 3 70B보다 훨씬 가볍게 움직인다는 뜻입니다. 이러한 AI 모델 병합 기술은 MoE가 가져온 ‘규모와 속도의 분리’ 혁명과 궤를 같이 합니다.

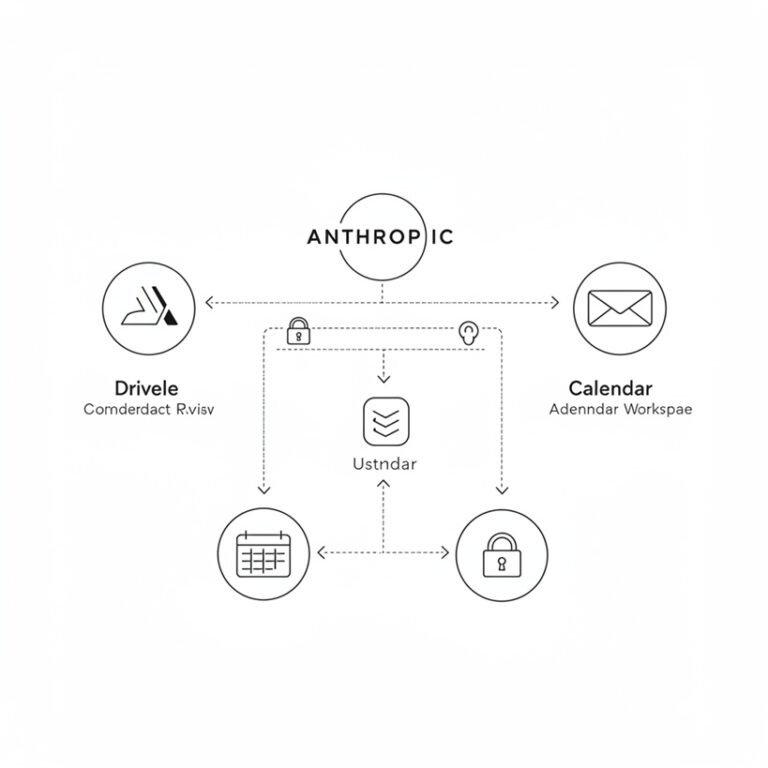

공유 전문가(Shared Expert)의 등장

초기 MoE는 전문가들이 각자 도생 하느라 공통 지식(상식, 문법 등)을 중복해서 배우는 낭비가 있었습니다. 이를 해결하기 위해 최근 아키텍처(DeepSeek 등)는 공유 전문가(Shared Expert)를 둡니다. 항상 활성화되어 기본기를 담당하는 전문가와, 필요할 때만 호출되는 라우팅 전문가를 분리하여 지식의 파편화를 막은 것입니다.

| 비교 항목 | Dense 모델 (Llama 3 70B 등) | MoE 모델 (Mixtral 8x7B, GPT-4) |

|---|---|---|

| 활성화 파라미터 | 100% (항상 전체 사용) | 10~15% (필요한 부분만 사용) |

| 추론 속도 (FLOPs) | 느림 (파라미터 수에 비례) | 빠름 (활성 파라미터 수에 비례) |

| VRAM 요구량 | 큼 | 매우 큼 (전체 파라미터 로드 필수) |

| 훈련 난이도 | 상대적으로 쉬움 | 어려움 (라우팅 밸런스 붕괴 위험) |

| 지식의 총량 | 파라미터 수에 비례 | 동일 연산량 대비 훨씬 큼 |

전략적 가치: 왜 빅테크는 MoE에 목숨을 거는가?

1. 추론 경제성(Inference Economy)의 승리

AI 비즈니스의 비용 90%는 학습이 아닌 서빙(Serving)에서 발생합니다. MoE는 훈련 비용은 조금 더 들지 몰라도, 서비스 단계에서의 압도적인 FLOPs(연산량) 절감을 통해 마진율을 개선합니다. 사용자 요청이 10배 늘어도 서버 증설 비용은 Dense 모델 대비 절반 수준으로 방어할 수 있습니다.

2. 무한 확장의 가능성

Dense 모델은 1T(1조) 파라미터를 넘어가면 학습 속도가 너무 느려집니다. 하지만 MoE는 전문가(Expert) 개수만 늘리면 되므로, 연산 비용 증가 없이 모델의 총 용량(Total Capacity)을 수조 개 단위로 확장할 수 있습니다. 이는 AI가 ‘더 많은 지식’을 담으면서도 ‘현실적인 속도’를 유지하는 유일한 방법이며, 경량 AI 모델의 성공 방정식을 제시합니다.

현장에서 마주할 병목과 기술적 해법

이론은 완벽해 보이지만, 실제 엔지니어링 단계에서는 피가 마르는 상황이 발생합니다. 제가 컨설팅하며 겪었던 대표적인 문제들과 해결책을 정리했습니다.

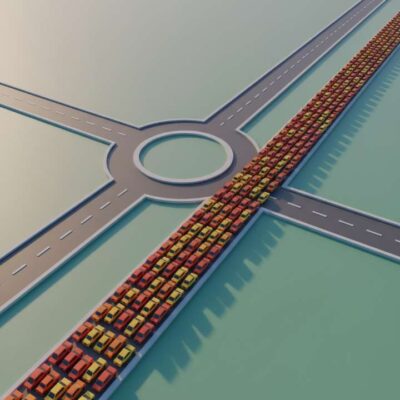

전문가 붕괴 (Expert Collapse): “왜 한 놈만 일해?”

가장 흔한 실패 사례입니다. 학습 초기에 특정 전문가(Expert A)가 우연히 조금 더 좋은 성과를 내면, 라우터가 모든 데이터를 Expert A에게만 몰아주기 시작합니다. 나머지 전문가들은 놀고, Expert A는 과부하가 걸려 결국 MoE가 아니라 그냥 뚱뚱한 Dense 모델이 되어버립니다.

- 증상: 8개의 전문가가 있는데 1번 전문가의 사용률이 90%를 찍음.

- 해법: Auxiliary Loss(보조 손실 함수)를 반드시 적용해야 합니다. 라우터가 한쪽으로 쏠리면 벌점(Loss)을 주어 강제로 데이터를 분산시키게 만듭니다. 최신 논문들은 여기에 더해 ‘Router Z-Loss’ 같은 안정화 기법을 사용하여 라우터의 편향을 억제합니다.

VRAM의 역설: “빠른데 메모리가 터져요”

많은 분들이 오해하는 부분입니다. “Mixtral 8x7B는 13B 수준으로 빠르다며? 그럼 VRAM도 13B만큼 먹겠지?” 천만의 말씀입니다. 연산은 13B만큼 하지만, 라우터가 언제 누구를 부를지 모르기 때문에 47B 파라미터 전체가 GPU 메모리(VRAM)에 상주해 있어야 합니다.

- 현실: Llama 3 8B는 16GB GPU에서 널널하게 돌지만, Mixtral 8x7B(약 47GB)는 A100이나 A6000급이 아니면 양자화(Quantization) 없이는 구동조차 불가능합니다.

- 해법: 로컬 구동 시에는 GGUF, EXL2 같은 4-bit 양자화가 필수입니다. 다행히 MoE는 전문가별로 역할이 분담되어 있어 양자화에 따른 성능 저하가 Dense 모델보다 덜한 편입니다. 서버 환경이라면 EP(Expert Parallelism) 기술을 써서 전문가들을 여러 GPU에 쪼개서 올려야 합니다.

파인튜닝의 배신

MoE 모델을 가져와서 특정 도메인(예: 법률)으로 파인튜닝(Fine-tuning)하려 할 때, 기존의 라우팅 능력이 깨지는 경우가 많습니다. 법률 데이터만 계속 주입하면, 라우터가 “아, 세상의 모든 문제는 법률 전문가가 풀어야 해”라고 착각하게 됩니다.

- 해법: 파인튜닝 시 QLoRA를 적용하되, 전문가(Experts) 레이어보다는 어텐션(Attention) 레이어 위주로 학습하거나, 라우터의 가중치(Weight)는 얼려두고(Freeze) 학습하는 전략이 유효합니다.

전망: 동적 컴퓨팅의 시대로

MoE는 이제 시작입니다. 앞으로는 전문가들의 크기가 서로 다른 이질적 MoE(Heterogeneous MoE)가 주류가 될 것입니다. 간단한 문법 교정은 작은 전문가가, 복잡한 코딩은 거대 전문가가 처리하는 식입니다. 또한, 하나의 토큰을 처리하는 데 필요한 연산량을 모델 스스로 결정하는 적응형 연산(Adaptive Computation)으로 진화할 것입니다.

MoE는 단순한 ‘기술’이 아니라, AI가 하드웨어의 한계를 소프트웨어적으로 돌파하려는 처절하고도 아름다운 전략입니다. 지금 여러분의 서비스가 ‘비용’과 ‘지능’ 사이에서 길을 잃었다면, 해답은 MoE에 있을 확률이 매우 높습니다.

—

MoE와 AI 비용 효율화 더 알아보기

MoE 모델을 통해 AI 추론 비용을 절감하는 방법을 더 깊이 탐구하고 싶다면, 다음 글들도 함께 살펴보세요.

MoE 모델은 로컬 PC(일반 GPU)에서 돌리기 어렵나요?

네, 까다롭습니다. 연산 속도는 빠르지만, 모든 전문가 파라미터를 VRAM에 올려야 하기 때문에 높은 VRAM 용량이 필요합니다. 예를 들어 Mixtral 8x7B를 온전히 돌리려면 약 48GB 이상의 VRAM이 필요하며, 일반 소비자용 GPU(24GB 이하)에서는 4-bit 이하로 심하게 양자화해야 구동 가능합니다.

MoE 모델을 파인튜닝할 때 주의할 점은 무엇인가요?

가장 큰 위험은 ‘전문가 붕괴(Expert Collapse)’와 ‘망각(Catastrophic Forgetting)’입니다. 특정 데이터셋으로 과도하게 학습하면 라우터가 특정 전문가만 호출하도록 편향될 수 있습니다. 이를 막기 위해 라우터를 Freeze(동결)하거나, Auxiliary Loss를 유지하며 학습하는 전략이 필수적입니다.

DeepSeek-V3 같은 최신 MoE 모델의 특징은 무엇인가요?

DeepSeek-V3는 ‘공유 전문가(Shared Expert)’ 개념을 도입했습니다. 모든 토큰이 공통적으로 거쳐가는 전문가를 두어 기본 지식을 공유하고, 특수 전문가(Routed Experts)는 세부 작업에 집중하게 함으로써 지식 파편화 문제를 해결하고 효율성을 극대화했습니다.